Künstliche Intelligenz und Alter(n)

Algorithmen und Künstliche Intelligenz (KI) sind längst auch im Kontext des Alter(n)s ein Thema geworden. Dabei wird vielfach auf die Potenziale von KI für die Pflege älterer Menschen hingewiesen (Bhatia 2024; Leung u. a. 2022). Insbesondere die Unterstützung älterer Menschen durch KI-Systeme und die Frage, wie die Pflege durch den Einsatz von KI optimiert werden kann, stehen dabei im Fokus der Technikentwicklung und -forschung.

Welche Herausforderungen bestehen beim Einsatz von KI für das höhere Alter?

In den letzten Jahren wurden vermehrt ethische Risiken im Kontext von KI diskutiert – auch hinsichtlich des Einsatzes von KI in der Pflege. Auf Basis einer Literaturübersicht identifiziert Rubeis (2020) vier Bereiche ethischer Risiken in der Anwendung aktueller KI-Technologien in der Pflege. Diese umfassen:

Weiters bestehen auch Herausforderungen hinsichtlich der Datenverfügbarkeit zum Training von KI-Systemen im Alter(n)skontext. Da Datenbanken, die für das Training von KI eingesetzt werden ältere Bevölkerungsgruppen kaum abbilden, ist die Funktionalität der KI für ältere Menschen vielfach eingeschränkt (Stypinska 2023; Chu u. a. 2022). So zeigt sich etwa für Technologien wie Gesichtserkennung und Spracherkennung, dass diese bei älteren Nutzer:innen deutlich fehleranfälliger sind, als bei jüngeren Personengruppen (Menezes u. a. 2021; Feng u. a. 2021).

Eine weitere Herausforderung in diesem Zusammenhang stellen Alter(n)sbilder dar, welche im Zuge der Technikentwicklung in KI-Technologien eingeschrieben werden. So wurde in den letzten Jahren vermehrt darauf hingewiesen, dass KI-Systeme, etwa im Bereich der Berufsvermittlung, sexistische und rassistische Stereotype reproduzieren und marginalisierte Gruppen so systematisch benachteiligen. Aus so einer Perspektive lässt sich danach fragen, welche Alter(n)sbilder – als stereotype Vorstellungen über das Alter(n) – durch KI-Systeme reproduziert werden.

Als ein Beispiel dafür lässt sich etwa danach fragen, welche Bilder über das Älterwerden von generativen KI produziert werden. Auf welche Art einseitige Alter(n)sbilder in KI-Technologien eingeschrieben sind, veranschaulichen die beiden untenstehenden Bilder, welche mit dem bildgenerierende KI-Tool „Night Café” erstellt wurden.

Abbildung 1 zeigt das Bild, dass die KI auf Basis der Eingabe (des sog. Prompts) „ageing” (übersetzt „altern”) erstellt hat.

Abbildung 2 zeigt ein weiteres generierte Bild, mit dem Prompt „old man and his AI” (übersetzt „Alter Mann und seine KI”)

Bildquelle/-generierung:

https://creator.nightcafe.studio/

Algorithmen vs. Alter(n) in der gerontologischen Literatur

Auch eine Analyse von gerontologischer Literatur zu Algorithmen und KI erlaubt es, Vorstellungen vom Alter(n) in entsprechende Technologien eingeschrieben sind zu analysieren. Mithilfe einer systematischen Literaturrecherche wurden Artikel des einflussstärksten Quartils internationaler gerontologischer Fachzeitschriften darauf untersucht, wie sie Alter(n) und Algorithmen darstellen.

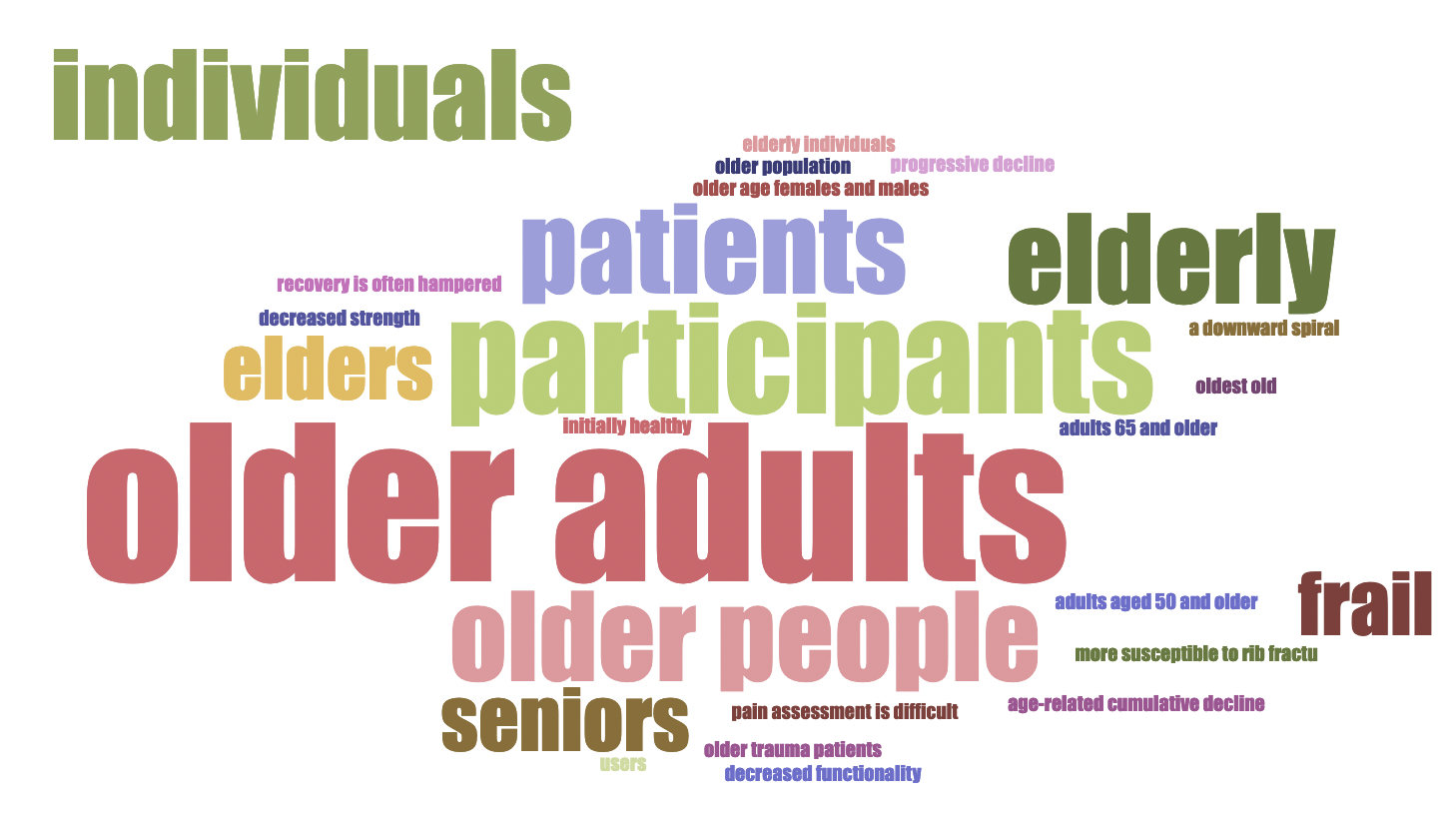

Die beiden untenstehenden Wortwolken verdeutlichen, worauf in der Literatur vielfach hingewiesen wird:

Algorithmische Technologien werden als tätige Problemlösungen verstanden, welche vermeintlich einfache, datengestützte Antworten auf komplexe gerontologische Fragen liefern (Abbildung 3). Worte, die dabei mit KI und algorithmischen Technologien in Verbindung gebracht werden, zeichnen erneut ein flexibles, dynamisches Bild eines intelligenten Systems, das Alter(n) misst, vorhersagt, und unterstützt.

Ältere Menschen werden in der untersuchten Literatur hingegen mit deutlich weniger Worten beschrieben (Abbildung 4). Sie sind vielfach nur „Teilnehmer:innen” und „Patient:innen”, oder als gebrechlich, schwach und anfällig verstanden. Weniger sichtbar werden im gerontologischen Diskurs zu KI bislang positive Alter(n)sbilder, die die Heterogenität des Älterwerdens oder die aktive Rolle älterer Menschen in der Auseinandersetzung mit neuen Technologien betonen.

Fazit: Wie kann der Einsatz von KI im Kontext von Alter(n) gelingen?

Die genannten Beispiele verdeutlichen ein einseitiges, defizitorientiertes Bild von Alter(n) im Kontext von künstlicher Intelligenz. Damit wird der Auftrag an eine kritische Gerontologie und Technologieforschung deutlich, auf die Heterogenität des Alter(n)s und potenzielle Gefahren des Einsatzes von KI hinzuweisen und ihre Berücksichtigung im Zuge der Technikentwicklung und -implementierung einzufordern. Partizipative Ansätze können es beispielsweise erlauben ältere Menschen aktiv in Forschungs- und Entscheidungsprozesse einzubinden und damit ihre Bedürfnisse, Erfahrungen und Perspektiven im Kontext von KI zu berücksichtigen. Zusammenfassend lässt kann der Einsatz von KI im Kontext des Alter(n)s gelingen, wenn …

… ältere Menschen aktiv in Prozesse der Technikentwicklung und -implementierung einbezogen werden – etwa durch partizipative Methoden.

… ethische Risiken reflektiert werden und Aspekte der Depersonalisierung, Diskriminierung, Dehumanisierung und Disziplinierung (Rubeis 2020, siehe oben) Berücksichtigung finden.

… die Heterogenität des Alter(n)s im Zuge technischer Innovationen beachtet wird und implizit (negative) Alter(n)sbilder nicht reproduziert werden.

ALGOCARE – das Projekt

Im WWTF geförderten Forschungsprojekt ALGOCARE (Laufzeit 2021-2025) gehen Vera Gallistl und Katrin Lehner gemeinsam mit den Projektpartner:innen der TU Wien und VICESSE Fragen der Erklärbarkeit, Bias und Transparenz von KI-Technologien mit Einsatz in der Langzeitpflege nach. Einen Überblick über die aktuelle Dissemination und Publikationen aus dem Projekt finden Sie auf der Projektwebsite (siehe Links, unten).

Weiterführende Links zum Thema

ALGOCARE Projektwebsite: https://algocare.cvl.tuwien.ac.at/

ALGOCARE Seite des Fördergeber WWTF: https://www.wwtf.at/funding/programmes/ict/ICT20-055/

Publikationshinweis: https://www.kl.ac.at/en/news/ageing-through-ai-fall-detectors-process-spacetimemattering

Bildgenerierende KI: https://creator.nightcafe.studio/